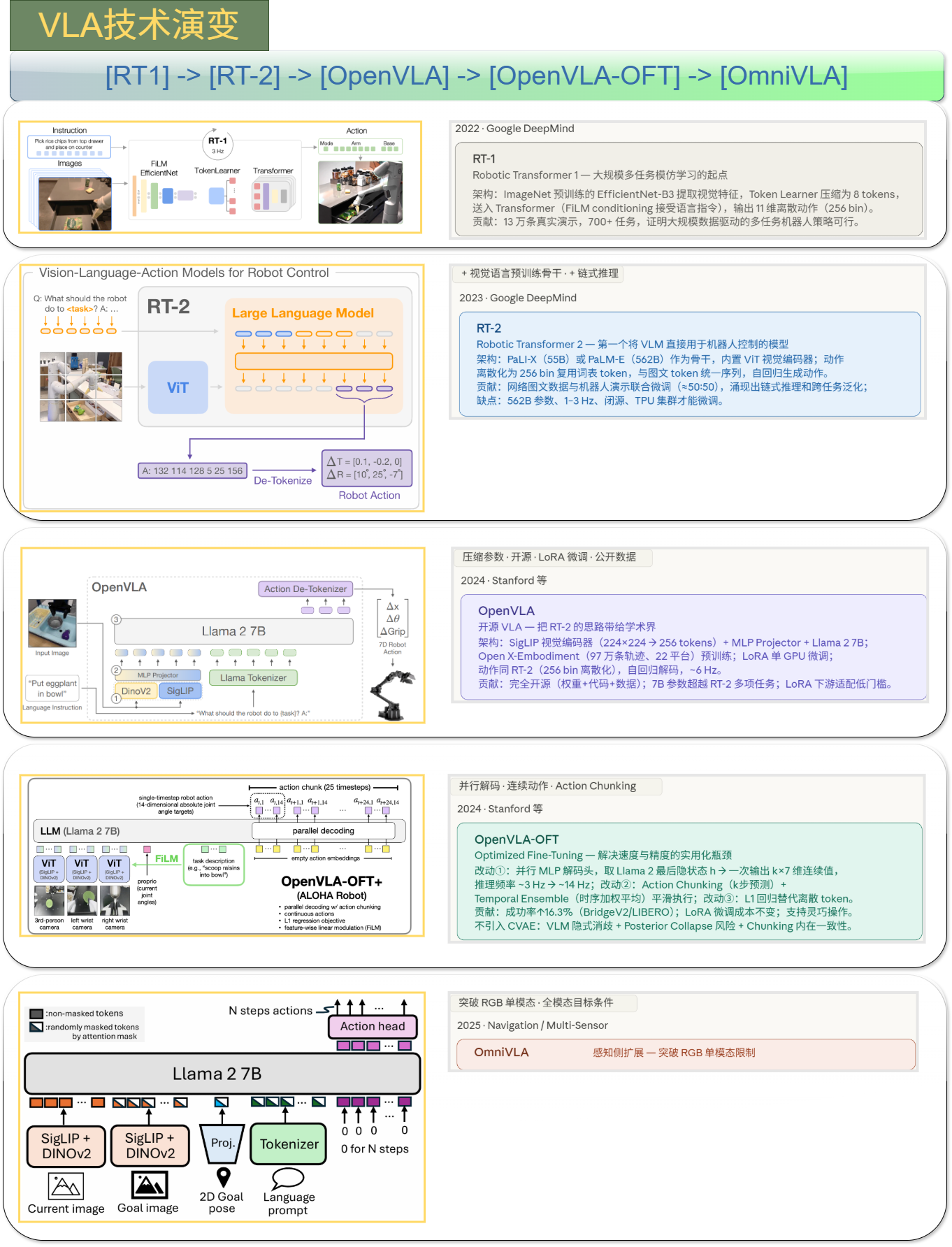

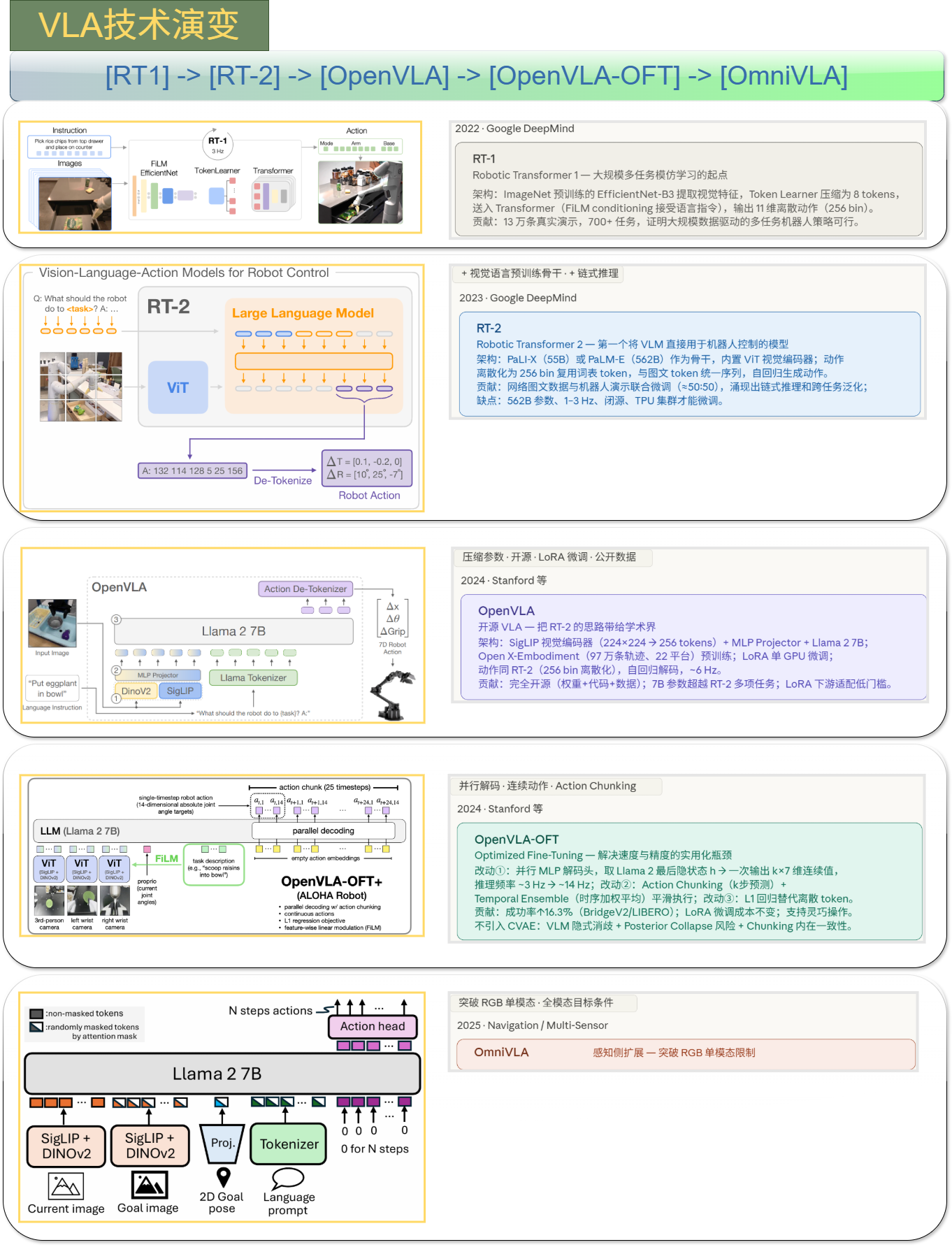

一条很清晰的演化主线:

RT-1:先把“机器人控制”做成 Transformer policy

RT-2:再把“互联网 VLM 的语义能力”接进来

OpenVLA:把这条路线开源化、做成通用基座

OpenVLA-OFT:把动作输出从“像写字一样生成”改到更适合控制

OmniVLA:把 VLA 从操作任务进一步推进到“多目标模态导航”。 (arXiv)

1)RT-1:Robotics Transformer,通用机器人策略的起点

架构

RT-1 本质上是一个端到端机器人 Transformer policy。它把相机观测和任务指令作为输入,输出离散化后的动作 token,用大规模真实机器人示范数据做多任务训练,核心目标是证明:机器人策略也能像 NLP/CV 一样,靠“大模型 + 大数据 + 多任务”获得可扩展性。论文强调它关注的是数据规模、模型规模和数据多样性如何影响机器人泛化。(arXiv)

贡献

RT-1 的最大贡献,不是“语义理解特别强”,而是它第一次比较系统地证明了:

- 真实机器人控制可以做成 Transformer;

- 多任务、任务无关的大规模训练是有效的;

- 一个统一策略可以覆盖很多桌面操作技能。(arXiv)

相对更早方法的改进

在 RT-1 之前,很多策略更像“单任务、单场景、单机器人”的 imitation/RL 模型;RT-1 把问题改写成了“统一策略学习”。但它仍然主要依赖机器人数据本身,语义泛化能力还有限。(arXiv)

2)RT-2:把 VLM 直接变成策略

架构

RT-2 的关键变化是:不再只用机器人专用 Transformer,当作策略骨干;而是直接从大视觉语言模型出发。它以 PaLI-X 或 PaLM-E 这类预训练 VLM 为 backbone,把机器人动作离散成文本式 action tokens,然后把互联网视觉语言数据和机器人数据一起 co-fine-tune,让模型统一输出文本 token / action token。也就是说,RT-2 本质上是“VLM-as-policy”。(arXiv)

贡献

RT-2 的里程碑意义在于:它证明了互联网级视觉语言知识可以迁移到机器人控制。机器人不只是“会做训练里见过的动作”,还会在语义层面表现出更强泛化,比如理解新物体、新描述、新组合条件。(arXiv)

相对 RT-1 的改进

RT-1 强在“控制可扩展”;RT-2 则把重点推到“语义泛化”。

RT-1 更像“机器人版多任务 policy”;RT-2 则是“借大 VLM 的世界知识来增强机器人”。但 RT-2 也继承了一个代价:它把动作当 token 生成,天然有离散化误差和自回归推理慢的问题。(arXiv)

3)OpenVLA:把 RT-2 路线真正开源化、工程化

架构

OpenVLA 是一个 7B 参数的开源 VLA。它用 Llama 2 作为语言骨干,视觉端融合 DINOv2 + SigLIP 特征,然后在 970k 条 Open X-Embodiment 真实机器人 demonstrations 上训练,输出仍然是动作 token,整体上延续了 RT-2 这类“统一多模态 backbone + 动作 token 生成”的范式。(arXiv)

贡献

OpenVLA 的核心贡献有三个:

第一,它把此前大多闭源的 VLA 体系真正做成了开源基座;

第二,它把训练代码、模型、微调流程一起开放,降低了社区进入门槛;

第三,它证明了一个 7B 开源模型可以在通用操作上取得很强结果,甚至在文中报告中超过某些更大的闭源基线。(arXiv)

相对 RT-2 的改进

OpenVLA 不是在思想上推翻 RT-2,而是在工程与生态上向前走了一大步:

- 从“Google 级别闭源大模型路线”变成“研究者可复现可微调的开源路线”;

- 从“证明 VLM 能做 policy”变成“提供一个大家真能拿来训、改、部署的 VLA 平台”。

但它依然保留了 RT-2 式的重要局限:动作仍然主要按 token 自回归生成。(arXiv)

4)OpenVLA-OFT:不再执着于“像语言一样生成动作”

架构

OpenVLA-OFT 不是完全新的基础模型,而是基于 OpenVLA 提出的优化微调配方。论文明确总结出的 OFT recipe 是:

- parallel decoding

- action chunking

- continuous action representation

- L1 regression objective。

也就是:从原来“离散 token、自回归、next-token prediction”的动作生成,改成“并行、连续、分块地预测动作”。(arXiv)

贡献

OpenVLA-OFT 的贡献不在“又换了个更大 backbone”,而在于它系统回答了一个关键问题:

VLA 应该怎么微调,才能既更快又更准?

论文报告它把 OpenVLA 在 LIBERO 上的平均成功率从 76.5% 提到 97.1%,同时动作生成吞吐提升 26×,并支持 ALOHA 双臂高频控制。(arXiv)

相对 OpenVLA 的改进

如果说 OpenVLA 还是“把动作伪装成语言”,那 OpenVLA-OFT 则开始承认:

机器人动作终究不是语言。

所以它的实质改进是从“VLM 统一建模”迈向“更贴近控制本质的动作建模”。

这一步非常关键,因为它把研究重点从“能不能做 VLA”推进到“怎样才是更合理的 VLA 输出范式”。(arXiv)

5)OmniVLA:把 VLA 从操作推进到“多模态目标导航”

架构

OmniVLA 是一篇 2025 年的导航方向工作,它建立在高容量 VLA backbone 之上,把任务从 manipulation 推向 navigation。其核心是支持多种目标条件模态:

- 2D goal pose

- egocentric goal image

- natural language

以及它们的组合。

从论文首页图和摘要可见,它用当前图像、目标图像/目标位姿/语言提示等作为输入,输出一段导航动作,并通过 randomized modality fusion 学习多模态条件导航。(arXiv)

贡献

OmniVLA 的贡献不是继续卷机械臂操作,而是把“VLA 的通用条件能力”扩展到导航中的多目标表示统一。它利用 10 个平台、9500+ 小时数据训练,强调模型对模态缺失的鲁棒性、对新环境的泛化,以及对自然语言导航指令的跟随能力。(arXiv)

相对 OpenVLA / OpenVLA-OFT 的改进

OmniVLA 的“改进”更准确说是任务域扩展 + 目标模态扩展:

- OpenVLA / OpenVLA-OFT 主要是 manipulation;

- OmniVLA 转向 navigation;

- 前者主要处理“当前观测 + 指令 → 操作动作”;

- 后者进一步统一“语言、目标图像、目标位姿”等多种导航目标表达。

所以 OmniVLA 不是简单地做“OpenVLA-OFT 的更快版”,而是把 VLA 的统一建模思想推进到“多模态目标条件导航 foundation model”。(arXiv)